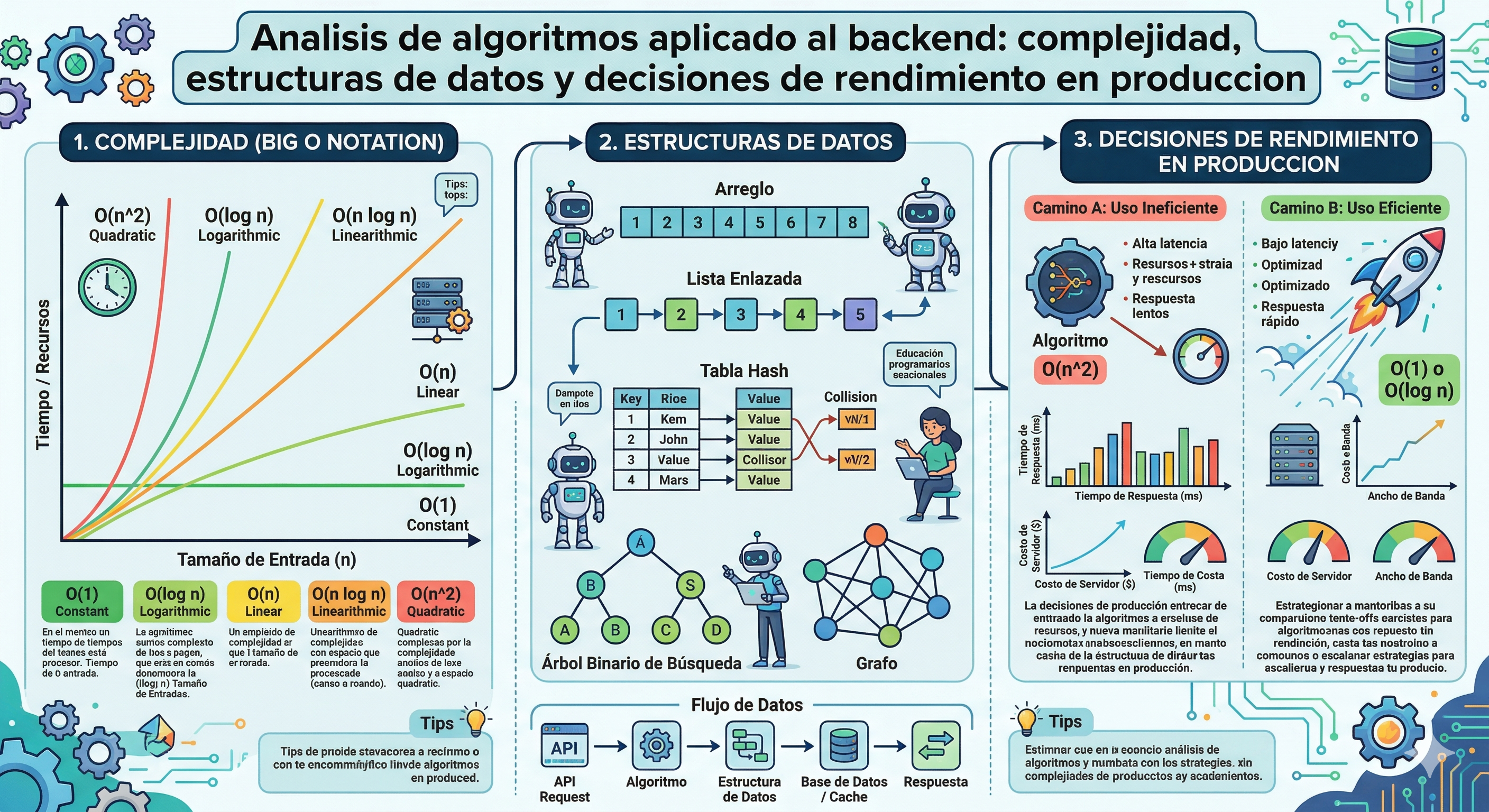

Análisis de algoritmos aplicado al backend: complejidad, estructuras de datos y decisiones de rendimiento en producción

Por Administrador | Publicado: 2026-03-18 23:48:00

Introducción

En backend moderno, el rendimiento no depende solo de infraestructura. Con frecuencia, el principal cuello de botella es una elección algorítmica deficiente: búsquedas lineales sobre grandes colecciones, ordenamientos repetitivos o joins mal planteados en capas incorrectas. Comprender complejidad temporal y espacial sigue siendo una ventaja competitiva real.

1. Complejidad teórica y costo real

Big O describe tendencia de crecimiento, no tiempo absoluto. Sin embargo, permite comparar estrategias. Una operación O(n) en una ruta de alta frecuencia puede ser más costosa que una operación O(n log n) que ocurre pocas veces. El diseño backend exige priorización por volumen de uso y criticidad de negocio.

2. Estructuras de datos y casos de uso

- Hash map: búsqueda promedio O(1), ideal para cache y deduplicación.

- Árbol balanceado: O(log n), útil cuando se requiere orden y rango.

- Heap: excelente para colas de prioridad.

- Bloom filter: prefiltrado probabilístico en validaciones masivas.

Seleccionar correctamente estas estructuras reduce carga de base de datos y mejora throughput.

3. Patrones ineficientes comunes

Patrón 1: validaciones de unicidad con loops anidados O(n^2). Patrón 2: agregaciones en aplicación que deberían delegarse a SQL con índices adecuados. Patrón 3: serializaciones costosas repetidas en cada request sin cache de representación.

4. Ejemplo práctico: feed ordenado por relevancia

Un feed que combina fecha, popularidad y afinidad puede resolverse de forma ingenua recorriendo toda la colección en cada solicitud. Una alternativa eficiente es precomputar score incremental en jobs asíncronos y almacenar ranking por ventana temporal.

# enfoque simplificado

score = (likes * 0.6) + (comentarios * 0.2) + (recencia * 0.2)

ordenar_por(score_desc)

cachear_top_n_por_segmento()Este cambio suele impactar más que una migración de hardware.

5. Complejidad espacial y memoria

Optimizar tiempo sin vigilar memoria puede causar degradación por garbage collector o swapping. En pipelines ETL y procesamiento batch, el uso de iteradores y streaming evita picos de memoria y estabiliza ejecución.

6. Índices y algoritmos en SQL

Un índice transforma búsquedas y ordenaciones, pero no es gratis: penaliza escritura y ocupa almacenamiento. Debe existir correlación directa entre índice y patrón de consulta. Mida selectividad y revise planes de ejecución antes de agregar o eliminar.

7. Medición: del laboratorio a producción

Benchmark local sin datos realistas puede inducir falsas conclusiones. Use muestras representativas, mida p95/p99, distribuya por endpoint y analice regresiones por release. Combine profiling de aplicación con análisis de queries.

8. Heurística de decisión

- Cuantifique volumen de datos y concurrencia.

- Identifique rutas con mayor costo por request.

- Compare alternativas algorítmicas con prueba controlada.

- Implemente cambios graduales con feature flags.

- Valide impacto en negocio: tiempo de respuesta, errores y costo.

9. Trade offs reales

No toda mejora de performance es prioritaria. En productos tempranos, claridad de código y velocidad de iteración pueden ser más valiosas que microoptimizaciones. En sistemas maduros de alto tráfico, la eficiencia algorítmica se vuelve esencial para sostener margen operativo.

Conclusiones

Análisis de algoritmos en backend no es teoría académica aislada. Es disciplina práctica para reducir latencia, controlar costos y elevar confiabilidad. Los equipos que dominan esta capacidad toman decisiones técnicas con evidencia, no con intuición.